Experimentální stanovení entropie českého textu

|

|

|

- Kamila Tesařová

- před 10 lety

- Počet zobrazení:

Transkript

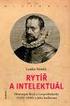

1 Experimentální stanovení entropie českého textu Antonín Novák Tomáš Báča 4. dubna 2012 Abstrakt Práce se zabývá analýzou českého textu. Zkoumali jsme syntaktickou strukturu psaného jazyka pomocí nástrojů teorie informace, zejména entropie. Zjistili jsme, že český jazyk vykazuje velkou redundanci a tím silnou míru vnitřní struktury. Výsledkem práce je stanovení entropie češtiny a konstrukce prediktoru českého textu včetně implementace komunikačního kompresního kanálu založeného na znalosti pravděpodobnostního modelu českých znaků a slov. Motivace V roce 1950 C. E. Shannon [1] publikoval článek pojednávající o možnostech predikce anglického textu. Jeho experimenty byly založeny na myšlence, že anglický jazyk vykazuje velmi silná vnitřní pravidla syntaxe a při znalosti těchto pravidel není úplně náhodné, jaké písmeno či slovo bude následovat po tom, které už známe. Ukazuje se například, že pravděpodobnosti písmen následujících v souvislém anglickém textu po písmenu T nemají rovnoměrné rozdělení. Je to způsobeno např. tím, že v angličtině je nejčastějším slovem člen the tudíž je poměrně pravděpodobné, že po T bude následovat právě H a ne například Q. Tyto a jiné podněty dovedly Shannona k tomu zkoumat míru této vnitřní struktury syntaxe s využitím nástrojů teorie informace. Intuitivně lze očekávat, že méně entropický (později definujeme přesněji) text bude snadnější predikovat, jelikož je méně náhodný tudíž je svázán jistým množstvím pravidel, které jeho syntaktickou strukturu do jisté míry předurčují. Všechny používané logaritmy v této práci jsou dvojkového základu (pokud není uvedeno jinak). Definice Neformálně řečeno, rozumný způsob, jak definovat entropii textu, je nahlížet na konkrétní jazyk jako na informační zdroj ((X n ) n N ) nad abecedou χ, pro který existuje pojem rychlosti entropie (entropie na znak). Tento způsob definice se ukazuje být opodstatněný a přináší své výsledky [1]. Dle [2, s. 173] existuje několik způsobů, jak tuto rychlost entropie najít. Jedním z nich je například metoda stanovení horní a dolní hranice rychlost entropie pomocí sázek na následující písmena obdobně jako při sázkách na koně a výsledky interpretovat pomocí narůstajícího bohatství z případných výher. Tato partie teorie informace nazývána gambling je rozebrána v [2]. My jsme v naší práci postupovali podobně jako C. E. Shannon - výpočtem z definice. Pro to si nejprve musíme přesně zavést několik pojmů. Budeme tedy určovat entropii českého textu - jednou nad abecedou bez mezery a za využití pravděpodobností koncových a počátečních písmen a druhou pro abecedou obsahující mezeru. 1

2 Náhodné veličiny Písmeno Náhodná veličina X reprezentuje písmeno textu. Je to diskrétní náhodná veličina s rozdělením p X nad abecedou χ = {A,...,Ž, }. Písmeno CH, ačkoliv se jedná o dva znaky, uvažujeme jako jeden. Mezera je v abecedě χ přítomna při druhé variantě experimentu odhadování entropie. N-gram Náhodný vektor G N reprezentuje N-gram českého textu (N náhodných veličin X). Je definován pomocí p N, kde p N je pravděpodobnostní rozdělení N-gramu nad množinou všech N- gramů (uspořádaných n-tic písmen) χ N. Například množina 2-gramů (digramů) je χ 2 ={AA,...,ŽŽ} ve variantě abecedy bez mezer. Čeština je náhodný proces ((X n ) n N ) nad abecedou χ, který považujeme za stacio- Čeština nární. Střední podmíněná entropie písmena Střední podmíněná entropie písmena X podmíněná (N-1)-gramem je: H N = H(X G N 1 ) = = p N 1 (y)h(x G N 1 = y) = y χ N 1 = p N (yx)log p N(yx) p N 1 (y) a vyjadřuje průměrné množství informace, kterou se dozvíme při pozorování X při předcházející znalosti předchozích N-1 písmen. Mezní rychlost entropie Mezní rychlost entropie náhodného procesu ((X n ) n N ) je definována jako limita posloupnosti středních podmíněných entropií a tedy platí: Výpočet H((X n ) n N ) = lim N H N (2) Jak jsme již zmínili výše, experiment jsme provedli pro dvě různé abecedy χ - s mezerou a bez mezery. CH bylo považováno za jedno písmeno. Všechna data vycházejí z 700 MB českého textu s diakritikou pocházejícího z české a světové literatury, který byl vhodně zpracován počítačem. (1) Odhady pravděpodobnostních rozdělení X a G N Rozdělení p X Pravděpodobností rozdělení p X odhadneme pomocí relativní četnosti písmen nad zkoumanými daty. Pro ilustraci uvádíme v tabulce 1 prvních osm nejčetnějších písmen. Rozdělení digramu G 2 Podobným způsobem odhadneme pravděpodobnostního rozdělení veličiny G 2. Výsledkem je rozdělení p 2. Na obrázku 1 vidíme, že pravděpodobností rozdělení p 2 není rovnoměrné - z toho je zřejmé, že syntaxe češtiny vykazuje vnitřní strukturu a slova jazyka se negenerují ze všech n-tic písmen rovnoměrně. Důkaz nerovnoměrnosti tohoto rozdělení není pro nás klíčový, proto jej ponecháváme bez důkazu jen pro ilustraci. Abeceda má uspořádání: A-Z, Á-Ž, CH. 2

3 písmeno pst. e o a n l t s i Tabulka 1: Nejčetnější písmena češtiny Obrázek 1: Pravděpodobnostní rozdělení digramů Rozdělení trigramu G 3 Odhad pravděpodobností trigramů p 3 pro případ abecedy χ obsahující mezeru je analogický s odhadem p 2. Pokud mezeru nepovažujeme za znak abecedy, postup stanovení rozdělení se mírně změní. Musíme vzít v úvahu i trigramy, které spojují dvě po sobě jdoucí slova. Například v sousloví hnijící koudel bychom rádi započítali výskyt trigramů cík a íko. Formule popsaná v [1], pomocí které upravíme odhadnuté pravděpodobnosti, vypadá následovně: p 3 (y 1 y 2 y 3 ) = ˆp 3(y 1 y 2 y 3 ) p T (y 1 )p 2 (y 2 y 3 ) p 2(y 1 y 2 )p S (y 3 ) (3) kde p S (y 1 ) je pst. že písmeno y 1 je začínajícím znakem slova, p T (y 3 ) je pst, že y 3 je koncovým znakem slova. Hodnota 5.83 je průměrná délka českého slova délky větší než 3 a vážena výskytem slova v textu je průměrný počet trigramů uvnitř českého slova. ˆp 3 je odhad na základě četnosti trojic písmen uvnitř slova. Tuto úpravu Shannon použil v [1] za předpokladu nezávislosti počátečního písmena jednoho slova a konečného písmena. Výpočtem s takto upraveným pravděpodobnostním rozdělením jsme dostali hodnotu H 3 větší než H 2, což indikuje chybu odhadu rozdělení. Proto soudíme, že tato metoda není pro češtinu 3

4 možná a dále pokračujeme s původními pravděpodobnostmi p relativni cetnost poradi cetnosti Obrázek 2: Sestupně seřazené pravděpodobnosti trigramů v log-log měřítku Četnosti slov 4-gramy a více již nebudeme konstruovat z podobných důvodů jako uvádí Shannon [1] - věrohodnost však takových dat je již daleko nižší než v případě trigramů. Lepším způsobem pro další aproximaci limity posloupnosti H N je použít četnosti slov. V [3] Zipf postuloval, že rovnice (4) platí pro mnoho různých jazyků. p n je relativní četnost n-tého nejčastějšího slova. My jsme pro češtinu určili tvar této rovnice (5). p n = k n (4) p n = { 0.03/n 0.6 n /n n > 10 Na obrázku 3 vidíme v log-log měřítku četnosti nejčastějších českých slov. Modře jsou vyznačena naše data, červeně aproximace k = 0.1 pro angličtinu dle Shannona [1]. Zeleně je naše aproximace (5) pro češtinu. Rychlost entropie Pro stacionární náhodné procesy (a češtinu za něj považujeme) platí věta, že rychlost entropie se rovná mezní rychlosti entropie: 1 H((X n ) n N ) = lim n n H(X 1,..., X n ) = H((X n ) n N ) Pro výpočet mezní rychlosti entropie použijeme vztah (2). Začneme postupně rozepisovat jednotlivé členy posloupnosti. Při prvním přiblížení uvažujeme jen počet písmen v abecedě (bez mezery): H 0 = log χ = 5.39 bits/znak (6) (5) 4

5 10 2 a data aproximace 2. radu aproximace 1. radu 10 3 kde pst. slova v textu dobre zarizení 10 6 nevydrzel 10 7 vtipnou poradi cetnosti slova Obrázek 3: Sestupně seřazené pravděpodobnosti slov v log-log měřítku Ve druhém uvažujeme jejich samotné četnosti: H 1 = x χ p X (x)log(p X (x)) = bits/znak (7) Pro výpočet dalších středních podmíněných entropií si výraz (1) přepíšeme do vhodnější formy: H N = H(X G N 1 ) = Čili bude platit: = = = = p N (yx)log p N(yx) p N 1 (y) p N (yx)[log(p N (yx)) log(p N 1 (y))] p N (yx)log(p N (yx)) p N (yx)log(p N 1 (y)) p N (yx)log(p N (yx)) + p N (yx)log(p N (yx)) + log(p N 1 (y)) p N (yx) } {{ } =p N 1 (y) y χ N 1 log(p N 1 (y))p N 1 (y) (8) 5

6 H 2 = H(X G 1 ) = p 2 (yx)log(p 2 (yx)) + log(p 1 (y))p 1 (y) y χ 1 y χ 1 x χ } {{ } = H 1 = = bits/znak a velmi podobně také pro trigramy: H 3 = H(X G 2 ) = p 3 (yx)log(p 3 (yx)) + log(p 2 (y))p 2 (y) (10) y χ 2 y χ 2 x χ = = bits/znak Při odhadu pravděpodobnostních rozdělení jsme diskutovali, že dále budeme postupovat podle aproximace pomocí četnosti slov rovnicí (5). Aby p n byla pravděpodobnost, musí pro ní platit: (9) p n = 1 (11) n=1 Je zřejmé že suma z rovnice (11) diverguje a tudíž součet nemůže být až do nekonečna. Hodnota n, pro kterou se p n = 1 je Bez jakéhokoliv nároku na lepší odhad entropie slova ji stanovujeme jako: H w = p n log(p n ) = bits/slovo = 2.07 bits/znak (12) n=1 Otázkou zůstává, s jakou hodnotou H N toto číslo ztotožnit. Ačkoliv je průměrná délka českého slova 5.83 znaků, tak entropie slova na znak je nižší než hodnota H Důvodem, který zmiňuje i Shannon v [1], je, že slovo jazyka vykazuje silnější vnitřní strukturu než uspořádaná 6tice písmen, což vyústí v menší entropii bloku písmen poskládaného do slova, jakožto jazykové jednotky se silnou strukturou. Lze soudit, že entropie slova přísluší hodnotě přibližně H 7 či H 8. abeceda H 0 H 1 H 2 H 3 H w 42 p p Tabulka 2: Posloupnost podmíněných entropií Vidíme, že jsou v podstatě zanedbatelné rozdíly mezi abecedou obsahující mezeru a abecedou bez mezery. Pokud češtinu modelujeme 2-Markovským modelem písmen, pak je její entropie rovna přibližně 3.17 bitů na písmeno. Pokud přistoupíme k modelování pomocí N-Markovského řetězce slov (kde N není příliš velké), pak lze očekávat, že entropie bude menší než námi zjištěná hodnota 2.07 bitů na písmeno. Ze znalosti českého jazyka je zřejmé, že věrnějším odhadem bude N-Markovský řetězec slov, kde N není příliš velké. Proto definujeme-li redundanci českého jazyka procentuální poměr entropie na znak mezi nezávislým náhodným zdrojem a N-Markovským řetězcem slov, pak redundance bude přibližně 40%. Výsledky Entropie českého textu Zjistili jsme, že rozdíly v rychlosti entropie procesu nad abecedou obsahující mezeru a and abecedou bez mezery jsou zanedbatelné. Pokud češtinu modelujeme jako N-Markovkský řetězec 6

7 slov, kde N není příliš velké (jednotky), pak je rychlost entropie takového zdroje přibližně: Tabulky četnosti slov a písmen češtiny H(((X n ) n N )) = 2.07 bits/znak (13) Pro výpočet entropie bylo třeba zkonstruovat tabulky četností písmen, digramů, trigramů a četnosti slov. Tyto tabulky jsou součástí práce a uvolňujeme je pod licencí Creative Commons Attribution-NonComercial-ShareAlike 3.0 Unported. Prediktor textu 2-Markovský řetězec znaků Tento popis modeluje češtinu tak, že pravděpodobnost výskytu písmena je podmíněna dvěma předcházejícími. Tento popis přirozeně neposkytuje kvalitní predikci celých slov, avšak slouží dobře na predikci předložek, spojek či obecně kratších stavebních prvků češtiny. Následuje ukázka textu, který takový prediktor dokáže vygenerovat: jed_doostval_st_ja_př_sesi_e_dvalka řejake_sen měo_so_spro a_pjede_v_mustoabyto_a_pe_mne_přie_z_prby_ku_a_d_pako mijí_ ohou_pby_i_skte_žeale_stle_ný_kola_dbyl_veprol_nter_v_e_m_mu 2-Markovský řetězec slov Podobně jako se znaky můžeme zacházet i se slovy. Za pomocí předchozí analýzy jsme byli schopni zkonstruovat prediktor, který maximalizuje pravděpodobnost podmíněnou dvěma předchozími slovy. Jeho výstup pro představu je možné vidět zde: jednoho_dne_se_vrátí_do_své_kanceláře_a_zavřel_oči_a_pak_se_ otočil_a_zamířil_k_němu_a_řekl_jsem_a_on_se_na_něj_a_jeho_hlas _zněl_trochu_drsně_díky_žaludečním_šťávám_a_projít_se_po_něm Komunikační predikční kanál Ve své práci [1] Shannon popsal model komunikačního kanálu založeného na umístění identických prediktorů na vstupu a výstupu. Tento kanál přenáší prázdné kódové slovo, pokud prediktor správně na první pokus určí slovo na vstupu. Toto rozhodování provádí na základě znalosti předchozích znaků zprávy. Pokud se nepodaří správně určit znak napoprvé, tak se pokračuje sestupně přes všechny pravděpodobnosti a odešle se číslo iterace, kdy nastala shoda. Za předpokladu identičnosti prediktorů je pak možno odeslanou zprávu bezchybně rekonstruovat. Prázdné kódové slovo, jenž indikuje správnou predikci, je příhodné kódovat nejkratším možným kódovým slovem (např. nulovým bitem). Ostatní přenášená kódová můžeme kódovat běžným způsobem (např. Huffmanovým kódem). original text reduced text original text comparison comparison predictor predictor Obrázek 4: Shannonův model komunikačního kanálu dle [1] Čím bude lepší predikce, tím méně bitů je třeba přenášet. V extrémních případech lze předpokládat, že z jednoho počátečního písmena budu schopen na druhém konci rekonstruovat celou 7

8 zprávu. Naše implementace využívá 2-Markovského řetězce slov vytvořeného z cca. 200 MB českého textu. Při větší velikosti dat jsme se již potýkali s výkonovými problémy. Lze předpokládat, že lepší implementací by bylo možné dosáhnout lepších výsledků. Naše implementace pracuje jen s celými slovy. Proto když predikce není vůbec možná (z nedostatku dat), tak se odešle celé slovo najednou. Jednou námi navrhovaných změn je začlenění 2-Markovského řetězce znaků do predikce. Pro ilustraci uvádíme zprávu včetně jejího přenosu naší implementací kanálu: vstup: ahoj_tondo_píšu_ti_protože_bych_se_rád_zeptal_jak_se_máš_jakpak_se_má_tvůj_kocour _už_jsem_ho_dlouho_neviděl poslaná zpráva: ahoj_tondo_píšu_ti 1 bych jakpak_se kocour_už_jsem výstup: ahoj_tondo_píšu_ti_protože_bych_se_rád_zeptal_jak_se_máš_jakpak_se_má_tvůj_kocour _už_jsem_ho_dlouho_neviděl Závěr Podařilo se nám ověřit předpoklad, že syntaxe českého jazyka vykazuje vnitřní strukturu, která redukuje jeho entropii. Rychlost entropie češtiny za předpokladu, že je modelována N-Markovským řetězcem slov, kde N je přiměřeně malé (jednotky) je menší než 2.07 bits/znak. Tato poměrně malá míra entropie implikuje větší předurčenost textu a tím jeho snadnější predikovatelnost. Se znalostí pravděpodobnostího rozdělení písmen a slov českého jazyka jsme byli schopni zkonstruovat komunikační kanál popsaný v [1]. Vzhledem k zajímavým výsledkům této práce věříme, že si problematika entropie textů zaslouží další zkoumání. Reference [1] SHANNON, C. E. Prediction and Entropy of Printed English [2] THOMAS M. COVER, JOY A. THOMAS, Elements of Information Theory. 2nd editon, 2006 [3] ZIPF, G. K., Human Behavior and the Principle of Least Effort, Addison-Wesley Press,

Teorie informace: řešené příklady 2014 Tomáš Kroupa

Teorie informace: řešené příklady 04 Tomáš Kroupa Kolik otázek je třeba v průměru položit, abychom se dozvěděli datum narození člověka (den v roce), pokud odpovědi jsou pouze ano/ne a tázaný odpovídá pravdivě?

Teorie informace: řešené příklady 04 Tomáš Kroupa Kolik otázek je třeba v průměru položit, abychom se dozvěděli datum narození člověka (den v roce), pokud odpovědi jsou pouze ano/ne a tázaný odpovídá pravdivě?

Algoritmy komprese dat

Algoritmy komprese dat Úvod do teorie informace Claude Shannon (1916 2001) 5.11.2014 NSWI072-7 Teorie informace Informace Co je to informace? Můžeme informaci měřit? Existují teoretické meze pro délku

Algoritmy komprese dat Úvod do teorie informace Claude Shannon (1916 2001) 5.11.2014 NSWI072-7 Teorie informace Informace Co je to informace? Můžeme informaci měřit? Existují teoretické meze pro délku

Vzdálenost jednoznačnosti a absolutně

Vzdálenost jednoznačnosti a absolutně bezpečné šifry Andrew Kozlík KA MFF UK Značení Pracujeme s šifrou (P, C, K, E, D), kde P je množina otevřených textů, C je množina šifrových textů, K je množina klíčů,

Vzdálenost jednoznačnosti a absolutně bezpečné šifry Andrew Kozlík KA MFF UK Značení Pracujeme s šifrou (P, C, K, E, D), kde P je množina otevřených textů, C je množina šifrových textů, K je množina klíčů,

13. cvičení z PSI ledna 2017

cvičení z PSI - 7 ledna 07 Asymptotické pravděpodobnosti stavů Najděte asymptotické pravděpodobnosti stavů Markovova řetězce s maticí přechodu / / / 0 P / / 0 / 0 0 0 0 0 0 jestliže počáteční stav je Řešení:

cvičení z PSI - 7 ledna 07 Asymptotické pravděpodobnosti stavů Najděte asymptotické pravděpodobnosti stavů Markovova řetězce s maticí přechodu / / / 0 P / / 0 / 0 0 0 0 0 0 jestliže počáteční stav je Řešení:

KOMPRESE OBRAZŮ. Václav Hlaváč, Jan Kybic. Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání.

1/25 KOMPRESE OBRAZŮ Václav Hlaváč, Jan Kybic Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání hlavac@fel.cvut.cz http://cmp.felk.cvut.cz/ hlavac KOMPRESE OBRAZŮ, ÚVOD

1/25 KOMPRESE OBRAZŮ Václav Hlaváč, Jan Kybic Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání hlavac@fel.cvut.cz http://cmp.felk.cvut.cz/ hlavac KOMPRESE OBRAZŮ, ÚVOD

KOMPRESE OBRAZŮ. Václav Hlaváč. Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání. hlavac@fel.cvut.

1/24 KOMPRESE OBRAZŮ Václav Hlaváč Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání hlavac@fel.cvut.cz http://cmp.felk.cvut.cz/ hlavac KOMPRESE OBRAZŮ, ÚVOD 2/24 Cíl:

1/24 KOMPRESE OBRAZŮ Václav Hlaváč Fakulta elektrotechnická ČVUT v Praze katedra kybernetiky, Centrum strojového vnímání hlavac@fel.cvut.cz http://cmp.felk.cvut.cz/ hlavac KOMPRESE OBRAZŮ, ÚVOD 2/24 Cíl:

Úvod do teorie informace

PEF MZLU v Brně 24. září 2007 Úvod Výměna informací s okolím nám umožňuje udržovat vlastní existenci. Proces zpracování informací je trvalý, nepřetržitý, ale ovlivnitelný. Zabezpečení informací je spojeno

PEF MZLU v Brně 24. září 2007 Úvod Výměna informací s okolím nám umožňuje udržovat vlastní existenci. Proces zpracování informací je trvalý, nepřetržitý, ale ovlivnitelný. Zabezpečení informací je spojeno

Markovské metody pro modelování pravděpodobnosti

Markovské metody pro modelování pravděpodobnosti rizikových stavů 1 Markovský řetězec Budeme uvažovat náhodný proces s diskrétním časem (náhodnou posloupnost) X(t), t T {0, 1, 2,... } s konečnou množinou

Markovské metody pro modelování pravděpodobnosti rizikových stavů 1 Markovský řetězec Budeme uvažovat náhodný proces s diskrétním časem (náhodnou posloupnost) X(t), t T {0, 1, 2,... } s konečnou množinou

Teorie informace II: obtížnější řešené příklady 2014 Tomáš Kroupa

Teorie informace II: obtížnější řešené příklady 204 Tomáš Kroupa. Máme n mincí, z nichž nejvýše jedna je falešná. Pozná se podle toho, že má jinou hmotnost než ostatní mince (ty váží všechny stejně). Mince

Teorie informace II: obtížnější řešené příklady 204 Tomáš Kroupa. Máme n mincí, z nichž nejvýše jedna je falešná. Pozná se podle toho, že má jinou hmotnost než ostatní mince (ty váží všechny stejně). Mince

1. Základy teorie přenosu informací

1. Základy teorie přenosu informací Úvodem citát o pojmu informace Informace je název pro obsah toho, co se vymění s vnějším světem, když se mu přizpůsobujeme a působíme na něj svým přizpůsobováním. N.

1. Základy teorie přenosu informací Úvodem citát o pojmu informace Informace je název pro obsah toho, co se vymění s vnějším světem, když se mu přizpůsobujeme a působíme na něj svým přizpůsobováním. N.

Inženýrská statistika pak představuje soubor postupů a aplikací teoretických principů v oblasti inženýrské činnosti.

Přednáška č. 1 Úvod do statistiky a počtu pravděpodobnosti Statistika Statistika je věda a postup jak rozvíjet lidské znalosti použitím empirických dat. Je založena na matematické statistice, která je

Přednáška č. 1 Úvod do statistiky a počtu pravděpodobnosti Statistika Statistika je věda a postup jak rozvíjet lidské znalosti použitím empirických dat. Je založena na matematické statistice, která je

Komprese dat (Komprimace dat)

Komprese dat (Komprimace dat) Př.: zakódovat slovo ARARAUNA K K 2 četnost absolutní relativní A 4,5 N,25 R 2,25 U,25 kód K : kód K 2 :... 6 bitů... 4 bitů prefixový kód: žádné kódové slovo není prefixem

Komprese dat (Komprimace dat) Př.: zakódovat slovo ARARAUNA K K 2 četnost absolutní relativní A 4,5 N,25 R 2,25 U,25 kód K : kód K 2 :... 6 bitů... 4 bitů prefixový kód: žádné kódové slovo není prefixem

Statistická teorie učení

Statistická teorie učení Petr Havel Marek Myslivec přednáška z 9. týdne 1 Úvod Představme si situaci výrobce a zákazníka, který si u výrobce objednal algoritmus rozpoznávání. Zákazník dodal experimentální

Statistická teorie učení Petr Havel Marek Myslivec přednáška z 9. týdne 1 Úvod Představme si situaci výrobce a zákazníka, který si u výrobce objednal algoritmus rozpoznávání. Zákazník dodal experimentální

8.3). S ohledem na jednoduchost a názornost je výhodné seznámit se s touto Základní pojmy a vztahy. Definice

9. Lineární diferenciální rovnice 2. řádu Cíle Diferenciální rovnice, v nichž hledaná funkce vystupuje ve druhé či vyšší derivaci, nazýváme diferenciálními rovnicemi druhého a vyššího řádu. Analogicky

9. Lineární diferenciální rovnice 2. řádu Cíle Diferenciální rovnice, v nichž hledaná funkce vystupuje ve druhé či vyšší derivaci, nazýváme diferenciálními rovnicemi druhého a vyššího řádu. Analogicky

Jednofaktorová analýza rozptylu

I I.I Jednofaktorová analýza rozptylu Úvod Jednofaktorová analýza rozptylu (ANOVA) se využívá při porovnání několika středních hodnot. Často se využívá ve vědeckých a lékařských experimentech, při kterých

I I.I Jednofaktorová analýza rozptylu Úvod Jednofaktorová analýza rozptylu (ANOVA) se využívá při porovnání několika středních hodnot. Často se využívá ve vědeckých a lékařských experimentech, při kterých

10. cvičení z PST. 5. prosince T = (n 1) S2 X. (n 1) s2 x σ 2 q χ 2 (n 1) (1 α 2 ). q χ 2 (n 1) 2. 2 x. (n 1) s. x = 1 6. x i = 457.

0 cvičení z PST 5 prosince 208 0 (intervalový odhad pro rozptyl) Soubor (70, 84, 89, 70, 74, 70) je náhodným výběrem z normálního rozdělení N(µ, σ 2 ) Určete oboustranný symetrický 95% interval spolehlivosti

0 cvičení z PST 5 prosince 208 0 (intervalový odhad pro rozptyl) Soubor (70, 84, 89, 70, 74, 70) je náhodným výběrem z normálního rozdělení N(µ, σ 2 ) Určete oboustranný symetrický 95% interval spolehlivosti

Limitní věty teorie pravděpodobnosti. Jiří Neubauer. Katedra ekonometrie, FVL, UO Brno kancelář 69a, tel

Katedra ekonometrie, FVL, UO Brno kancelář 69a, tel. 973 442029 email:jiri.neubauer@unob.cz Jestliže opakujeme nezávisle nějaký pokus, můžeme z pozorovaných hodnot sestavit rozdělení relativních četností

Katedra ekonometrie, FVL, UO Brno kancelář 69a, tel. 973 442029 email:jiri.neubauer@unob.cz Jestliže opakujeme nezávisle nějaký pokus, můžeme z pozorovaných hodnot sestavit rozdělení relativních četností

Úvod do teorie kódování

Úvod do teorie kódování Matematické základy komprese a digitální komunikace Tomáš Kroupa http://staff.utia.cas.cz/kroupa/ upravil Mirko Navara http://cmp.felk.cvut.cz/~navara/ 12. 1. 2017 Part I Úvod Teorie

Úvod do teorie kódování Matematické základy komprese a digitální komunikace Tomáš Kroupa http://staff.utia.cas.cz/kroupa/ upravil Mirko Navara http://cmp.felk.cvut.cz/~navara/ 12. 1. 2017 Part I Úvod Teorie

Pravděpodobnost a statistika

Pravděpodobnost a statistika 1 Náhodné pokusy a náhodné jevy Činnostem, jejichž výsledek není jednoznačně určen podmínkami, za kterých probíhají, a které jsou (alespoň teoreticky) neomezeně opakovatelné,

Pravděpodobnost a statistika 1 Náhodné pokusy a náhodné jevy Činnostem, jejichž výsledek není jednoznačně určen podmínkami, za kterých probíhají, a které jsou (alespoň teoreticky) neomezeně opakovatelné,

Zadání druhého zápočtového projektu Základy algoritmizace, 2005

Zadání druhého zápočtového projektu Základy algoritmizace, 2005 Jiří Dvorský 2 května 2006 Obecné pokyny Celkem je k dispozici 8 zadání příkladů Každý student obdrží jedno zadání Vzhledem k tomu, že odpadly

Zadání druhého zápočtového projektu Základy algoritmizace, 2005 Jiří Dvorský 2 května 2006 Obecné pokyny Celkem je k dispozici 8 zadání příkladů Každý student obdrží jedno zadání Vzhledem k tomu, že odpadly

Základy teorie pravděpodobnosti

Základy teorie pravděpodobnosti Náhodný jev Pravděpodobnost náhodného jevu Roman Biskup (zapálený) statistik ve výslužbě, aktuálně analytik v praxi ;-) roman.biskup(at)email.cz 15. srpna 2012 Statistika

Základy teorie pravděpodobnosti Náhodný jev Pravděpodobnost náhodného jevu Roman Biskup (zapálený) statistik ve výslužbě, aktuálně analytik v praxi ;-) roman.biskup(at)email.cz 15. srpna 2012 Statistika

7. Rozdělení pravděpodobnosti ve statistice

7. Rozdělení pravděpodobnosti ve statistice Statistika nuda je, má však cenné údaje, neklesejte na mysli, ona nám to vyčíslí Jednou z úloh statistiky je odhad (výpočet) hodnot statistického znaku x i,

7. Rozdělení pravděpodobnosti ve statistice Statistika nuda je, má však cenné údaje, neklesejte na mysli, ona nám to vyčíslí Jednou z úloh statistiky je odhad (výpočet) hodnot statistického znaku x i,

Poznámky k předmětu Aplikovaná statistika, 11. téma

Poznámky k předmětu Aplikovaná statistika, 11. téma Testy založené na χ 2 rozdělení V přehledu významných rozdělení jsme si uvedli, že Poissonovým rozdělením se modeluje počet událostí, které nastanou

Poznámky k předmětu Aplikovaná statistika, 11. téma Testy založené na χ 2 rozdělení V přehledu významných rozdělení jsme si uvedli, že Poissonovým rozdělením se modeluje počet událostí, které nastanou

Bakalářská práce Nejslabší! Máte padáka! Strategie ukládání

Západočeská univerzita v Plzni Fakulta aplikovaných věd Katedra matematiky Bakalářská práce Nejslabší! Máte padáka! Strategie ukládání Plzeň 2015 Jiří Šebek Prohlášení Prohlašuji, že jsem bakalářskou práci

Západočeská univerzita v Plzni Fakulta aplikovaných věd Katedra matematiky Bakalářská práce Nejslabší! Máte padáka! Strategie ukládání Plzeň 2015 Jiří Šebek Prohlášení Prohlašuji, že jsem bakalářskou práci

Fyzikální korespondenční seminář MFF UK

Úloha I.S... náhodná 10 bodů; průměr 7,04; řešilo 45 studentů a) Zkuste vlastními slovy popsat, co je to náhodná veličina a jaké má vlastnosti (postačí vlastními slovy objasnit následující pojmy: náhodná

Úloha I.S... náhodná 10 bodů; průměr 7,04; řešilo 45 studentů a) Zkuste vlastními slovy popsat, co je to náhodná veličina a jaké má vlastnosti (postačí vlastními slovy objasnit následující pojmy: náhodná

Teorie informace Obsah. Kybernetika. Radim Farana Podklady pro výuku

Teorie Radim Farana Podklady pro výuku Obsah Seznámení s problematikou a obsahem studovaného předmětu. Základní pojmy z Teorie, jednotka, informační obsah zprávy, střední délka zprávy, redundance. Kód.

Teorie Radim Farana Podklady pro výuku Obsah Seznámení s problematikou a obsahem studovaného předmětu. Základní pojmy z Teorie, jednotka, informační obsah zprávy, střední délka zprávy, redundance. Kód.

11. cvičení z PSI prosince hodnota pozorovaná četnost n i p X (i) = q i (1 q), i N 0.

11 cvičení z PSI 12-16 prosince 2016 111 (Test dobré shody - geometrické rozdělení Realizací náhodné veličiny X jsme dostali následující četnosti výsledků: hodnota 0 1 2 3 4 5 6 pozorovaná četnost 29 15

11 cvičení z PSI 12-16 prosince 2016 111 (Test dobré shody - geometrické rozdělení Realizací náhodné veličiny X jsme dostali následující četnosti výsledků: hodnota 0 1 2 3 4 5 6 pozorovaná četnost 29 15

Náhodné (statistické) chyby přímých měření

Náhodné (statistické) chyby přímých měření Hodnoty náhodných chyb se nedají stanovit předem, ale na základě počtu pravděpodobnosti lze zjistit, která z možných naměřených hodnot je více a která je méně

Náhodné (statistické) chyby přímých měření Hodnoty náhodných chyb se nedají stanovit předem, ale na základě počtu pravděpodobnosti lze zjistit, která z možných naměřených hodnot je více a která je méně

Teorie informace a kódování (KMI/TIK) Reed-Mullerovy kódy

Teorie informace a kódování (KMI/TIK) Reed-Mullerovy kódy Lukáš Havrlant Univerzita Palackého 10. ledna 2014 Primární zdroj Jiří Adámek: Foundations of Coding. Strany 137 160. Na webu ke stažení, heslo:

Teorie informace a kódování (KMI/TIK) Reed-Mullerovy kódy Lukáš Havrlant Univerzita Palackého 10. ledna 2014 Primární zdroj Jiří Adámek: Foundations of Coding. Strany 137 160. Na webu ke stažení, heslo:

Pravděpodobnost a její vlastnosti

Pravděpodobnost a její vlastnosti 1 Pravděpodobnost a její vlastnosti Náhodné jevy Náhodný jev je výsledek pokusu (tj. realizace určitého systému podmínek) a jeho charakteristickým rysem je, že může, ale

Pravděpodobnost a její vlastnosti 1 Pravděpodobnost a její vlastnosti Náhodné jevy Náhodný jev je výsledek pokusu (tj. realizace určitého systému podmínek) a jeho charakteristickým rysem je, že může, ale

Stochastické modely Informace k závěrečné zkoušce

Stochastické modely Informace k závěrečné zkoušce Jan Zouhar Katedra ekonometrie, FIS VŠE v Praze, zouharj@vse.cz 10. února 2015 Průběh zkoušky. Zkouška je ústní s přípravou na potítku. Každý si vylosuje

Stochastické modely Informace k závěrečné zkoušce Jan Zouhar Katedra ekonometrie, FIS VŠE v Praze, zouharj@vse.cz 10. února 2015 Průběh zkoušky. Zkouška je ústní s přípravou na potítku. Každý si vylosuje

14. cvičení z PSI. 9. ledna Pro každý stav platí, že všechny hrany z něj vycházející mají stejnou pravděpodobnost.

4. cvičení z PSI 9. ledna 09 4. rozdělení po mnoha krocích) Markovův řetězec je dán obrázkem: 8 9 4 7 6 Pro každý stav platí, že všechny hrany z něj vycházející mají stejnou pravděpodobnost. a) Klasifikujte

4. cvičení z PSI 9. ledna 09 4. rozdělení po mnoha krocích) Markovův řetězec je dán obrázkem: 8 9 4 7 6 Pro každý stav platí, že všechny hrany z něj vycházející mají stejnou pravděpodobnost. a) Klasifikujte

12. cvičení z PST. 20. prosince 2017

1 cvičení z PST 0 prosince 017 11 test rozptylu normálního rozdělení Do laboratoře bylo odesláno n = 5 stejných vzorků krve ke stanovení obsahu alkoholu X v promilích alkoholu Výsledkem byla realizace

1 cvičení z PST 0 prosince 017 11 test rozptylu normálního rozdělení Do laboratoře bylo odesláno n = 5 stejných vzorků krve ke stanovení obsahu alkoholu X v promilích alkoholu Výsledkem byla realizace

Teorie rozhodování (decision theory)

Umělá inteligence II Roman Barták, KTIML roman.bartak@mff.cuni.cz http://ktiml.mff.cuni.cz/~bartak Teorie pravděpodobnosti (probability theory) popisuje v co má agent věřit na základě pozorování. Teorie

Umělá inteligence II Roman Barták, KTIML roman.bartak@mff.cuni.cz http://ktiml.mff.cuni.cz/~bartak Teorie pravděpodobnosti (probability theory) popisuje v co má agent věřit na základě pozorování. Teorie

VYUŽITÍ PRAVDĚPODOBNOSTNÍ METODY MONTE CARLO V SOUDNÍM INŽENÝRSTVÍ

VYUŽITÍ PRAVDĚPODOBNOSTNÍ METODY MONTE CARLO V SOUDNÍM INŽENÝRSTVÍ Michal Kořenář 1 Abstrakt Rozvoj výpočetní techniky v poslední době umožnil také rozvoj výpočetních metod, které nejsou založeny na bázi

VYUŽITÍ PRAVDĚPODOBNOSTNÍ METODY MONTE CARLO V SOUDNÍM INŽENÝRSTVÍ Michal Kořenář 1 Abstrakt Rozvoj výpočetní techniky v poslední době umožnil také rozvoj výpočetních metod, které nejsou založeny na bázi

Teorie informace. Mirko Navara. katedra kybernetiky FEL ČVUT Karlovo náměstí, budova G, místnost 104a navara/psi 3. 1.

Teorie informace Mirko Navara Centrum strojového vnímání katedra kbernetik FEL ČVUT Karlovo náměstí, budova G, místnost 4a http://cmp.felk.cvut.cz/ navara/psi.. 7 Obsah Informace Entropie. Entropie jako

Teorie informace Mirko Navara Centrum strojového vnímání katedra kbernetik FEL ČVUT Karlovo náměstí, budova G, místnost 4a http://cmp.felk.cvut.cz/ navara/psi.. 7 Obsah Informace Entropie. Entropie jako

Odhady - Sdružené rozdělení pravděpodobnosti

Odhady - Sdružené rozdělení pravděpodobnosti 4. listopadu 203 Kdybych chtěl znát maximum informací o náhodné veličině, musel bych znát všechny hodnoty, které mohou padnout, a jejich pravděpodobnosti. Tedy

Odhady - Sdružené rozdělení pravděpodobnosti 4. listopadu 203 Kdybych chtěl znát maximum informací o náhodné veličině, musel bych znát všechny hodnoty, které mohou padnout, a jejich pravděpodobnosti. Tedy

Uvod Modely n-tic Vyhodnocov an ı Vyhlazov an ı a stahov an ı Rozˇ s ıˇ ren ı model u n-tic Jazykov e modelov an ı Pavel Smrˇ z 27.

Jazykové modelování Pavel Smrž 27. listopadu 2006 Osnova 1 Úvod motivace, základní pojmy 2 Modely n-tic 3 Způsob vyhodnocování 4 Vyhlazování a stahování 5 Rozšíření modelů n-tic 6 Lingvisticky motivované

Jazykové modelování Pavel Smrž 27. listopadu 2006 Osnova 1 Úvod motivace, základní pojmy 2 Modely n-tic 3 Způsob vyhodnocování 4 Vyhlazování a stahování 5 Rozšíření modelů n-tic 6 Lingvisticky motivované

Přednáška 3: Limita a spojitost

3 / 1 / 17, 1:38 Přednáška 3: Limita a spojitost Limita funkce Nejdříve je potřeba upřesnit pojmy, které přesněji popisují (topologickou) strukturu množiny reálných čísel, a to zejména pojem okolí 31 Definice

3 / 1 / 17, 1:38 Přednáška 3: Limita a spojitost Limita funkce Nejdříve je potřeba upřesnit pojmy, které přesněji popisují (topologickou) strukturu množiny reálných čísel, a to zejména pojem okolí 31 Definice

Diskrétní matematika. DiM /01, zimní semestr 2016/2017

Diskrétní matematika Petr Kovář petr.kovar@vsb.cz Vysoká škola báňská Technická univerzita Ostrava DiM 470-2301/01, zimní semestr 2016/2017 O tomto souboru Tento soubor je zamýšlen především jako pomůcka

Diskrétní matematika Petr Kovář petr.kovar@vsb.cz Vysoká škola báňská Technická univerzita Ostrava DiM 470-2301/01, zimní semestr 2016/2017 O tomto souboru Tento soubor je zamýšlen především jako pomůcka

Definice. Vektorový prostor V nad tělesem T je množina s operacemi + : V V V, tj. u, v V : u + v V : T V V, tj. ( u V )( a T ) : a u V které splňují

Definice. Vektorový prostor V nad tělesem T je množina s operacemi + : V V V, tj. u, v V : u + v V : T V V, tj. ( u V )( a T ) : a u V které splňují 1. u + v = v + u, u, v V 2. (u + v) + w = u + (v + w),

Definice. Vektorový prostor V nad tělesem T je množina s operacemi + : V V V, tj. u, v V : u + v V : T V V, tj. ( u V )( a T ) : a u V které splňují 1. u + v = v + u, u, v V 2. (u + v) + w = u + (v + w),

Matematika III. Miroslava Dubcová, Daniel Turzík, Drahoslava Janovská. Ústav matematiky

Matematika III Řady Miroslava Dubcová, Daniel Turzík, Drahoslava Janovská Ústav matematiky Přednášky ZS 202-203 Obsah Číselné řady. Součet nekonečné řady. Kritéria konvergence 2 Funkční řady. Bodová konvergence.

Matematika III Řady Miroslava Dubcová, Daniel Turzík, Drahoslava Janovská Ústav matematiky Přednášky ZS 202-203 Obsah Číselné řady. Součet nekonečné řady. Kritéria konvergence 2 Funkční řady. Bodová konvergence.

Intuitivní pojem pravděpodobnosti

Pravděpodobnost Intuitivní pojem pravděpodobnosti Intuitivní pojem pravděpodobnosti Pravděpodobnost zkoumaného jevu vyjadřuje míru naděje, že tento jev nastane. Řekneme-li, že má nějaký jev pravděpodobnost

Pravděpodobnost Intuitivní pojem pravděpodobnosti Intuitivní pojem pravděpodobnosti Pravděpodobnost zkoumaného jevu vyjadřuje míru naděje, že tento jev nastane. Řekneme-li, že má nějaký jev pravděpodobnost

Náhodné chyby přímých měření

Náhodné chyby přímých měření Hodnoty náhodných chyb se nedají stanovit předem, ale na základě počtu pravděpodobnosti lze zjistit, která z možných naměřených hodnot je více a která je méně pravděpodobná.

Náhodné chyby přímých měření Hodnoty náhodných chyb se nedají stanovit předem, ale na základě počtu pravděpodobnosti lze zjistit, která z možných naměřených hodnot je více a která je méně pravděpodobná.

Automatizační technika. Obsah

7.09.016 Akademický rok 016/017 Připravil: Radim Farana Automatizační technika Základy teorie Obsah Informace Jednotka Zdroj Kód Přenosový řetězec Prostředky sběru, zobrazování, přenosu, zpracování a úschovy

7.09.016 Akademický rok 016/017 Připravil: Radim Farana Automatizační technika Základy teorie Obsah Informace Jednotka Zdroj Kód Přenosový řetězec Prostředky sběru, zobrazování, přenosu, zpracování a úschovy

NÁHODNÁ ČÍSLA. F(x) = 1 pro x 1. Náhodná čísla lze generovat některým z následujících generátorů náhodných čísel:

NÁHODNÁ ČÍSLA TYPY GENERÁTORŮ, LINEÁRNÍ KONGRUENČNÍ GENERÁTORY, TESTY NÁHODNOSTI, VYUŽITÍ HODNOT NÁHODNÝCH VELIČIN V SIMULACI CO JE TO NÁHODNÉ ČÍSLO? Náhodné číslo definujeme jako nezávislé hodnoty z rovnoměrného

NÁHODNÁ ČÍSLA TYPY GENERÁTORŮ, LINEÁRNÍ KONGRUENČNÍ GENERÁTORY, TESTY NÁHODNOSTI, VYUŽITÍ HODNOT NÁHODNÝCH VELIČIN V SIMULACI CO JE TO NÁHODNÉ ČÍSLO? Náhodné číslo definujeme jako nezávislé hodnoty z rovnoměrného

Pravděpodobnost a aplikovaná statistika

Pravděpodobnost a aplikovaná statistika MGR. JANA SEKNIČKOVÁ, PH.D. 2. KAPITOLA PODMÍNĚNÁ PRAVDĚPODOBNOST 3. KAPITOLA NÁHODNÁ VELIČINA 9.11.2017 Opakování Uveďte příklad aplikace geometrické definice pravděpodobnosti

Pravděpodobnost a aplikovaná statistika MGR. JANA SEKNIČKOVÁ, PH.D. 2. KAPITOLA PODMÍNĚNÁ PRAVDĚPODOBNOST 3. KAPITOLA NÁHODNÁ VELIČINA 9.11.2017 Opakování Uveďte příklad aplikace geometrické definice pravděpodobnosti

Bayesovské metody. Mnohorozměrná analýza dat

Mnohorozměrná analýza dat Podmíněná pravděpodobnost Definice: Uvažujme náhodné jevy A a B takové, že P(B) > 0. Podmíněnou pravěpodobností jevu A za podmínky, že nastal jev B, nazýváme podíl P(A B) P(A

Mnohorozměrná analýza dat Podmíněná pravděpodobnost Definice: Uvažujme náhodné jevy A a B takové, že P(B) > 0. Podmíněnou pravěpodobností jevu A za podmínky, že nastal jev B, nazýváme podíl P(A B) P(A

Pravděpodobnost a statistika (BI-PST) Cvičení č. 9

Pravděpodobnost a statistika (BI-PST) Cvičení č. 9 R. Blažek, M. Jiřina, J. Hrabáková, I. Petr, F. Štampach, D. Vašata Katedra aplikované matematiky Fakulta informačních technologií České vysoké učení

Pravděpodobnost a statistika (BI-PST) Cvičení č. 9 R. Blažek, M. Jiřina, J. Hrabáková, I. Petr, F. Štampach, D. Vašata Katedra aplikované matematiky Fakulta informačních technologií České vysoké učení

Téma 2: Pravděpodobnostní vyjádření náhodných veličin

0.025 0.02 0.015 0.01 0.005 Nominální napětí v pásnici Std Mean 140 160 180 200 220 240 260 Std Téma 2: Pravděpodobnostní vyjádření náhodných veličin Přednáška z předmětu: Pravděpodobnostní posuzování

0.025 0.02 0.015 0.01 0.005 Nominální napětí v pásnici Std Mean 140 160 180 200 220 240 260 Std Téma 2: Pravděpodobnostní vyjádření náhodných veličin Přednáška z předmětu: Pravděpodobnostní posuzování

Komprese obrazu. Úvod. Rozdělení metod komprese obrazů. Verze: 1.5, ze dne: 1. června Václav Hlaváč a Tomáš Svoboda

Komprese obrazu Verze:., ze dne:. června 6 Václav Hlaváč a Tomáš Svoboda Czech Technical University, Faculty of Electrical Engineering Center for Machine Perception, Prague, Czech Republic svoboda@cmp.felk.cvut.cz

Komprese obrazu Verze:., ze dne:. června 6 Václav Hlaváč a Tomáš Svoboda Czech Technical University, Faculty of Electrical Engineering Center for Machine Perception, Prague, Czech Republic svoboda@cmp.felk.cvut.cz

letní semestr Katedra pravděpodobnosti a matematické statistiky Matematicko-fyzikální fakulta Univerzity Karlovy Matematická statistika vektory

Šárka Hudecová Katedra pravděpodobnosti a matematické statistiky Matematicko-fyzikální fakulta Univerzity Karlovy letní semestr 202 Založeno na materiálech doc. Michala Kulicha Náhodný vektor často potřebujeme

Šárka Hudecová Katedra pravděpodobnosti a matematické statistiky Matematicko-fyzikální fakulta Univerzity Karlovy letní semestr 202 Založeno na materiálech doc. Michala Kulicha Náhodný vektor často potřebujeme

Komprese obrazu. Verze: 1.5, ze dne: 1. června Václav Hlaváč a Tomáš Svoboda

Komprese obrazu Verze: 1.5, ze dne: 1. června 2006 Václav Hlaváč a Tomáš Svoboda Czech Technical University, Faculty of Electrical Engineering Center for Machine Perception, Prague, Czech Republic svoboda@cmp.felk.cvut.cz

Komprese obrazu Verze: 1.5, ze dne: 1. června 2006 Václav Hlaváč a Tomáš Svoboda Czech Technical University, Faculty of Electrical Engineering Center for Machine Perception, Prague, Czech Republic svoboda@cmp.felk.cvut.cz

5. Náhodná veličina. 2. Házíme hrací kostkou dokud nepadne šestka. Náhodná veličina nabývá hodnot z posloupnosti {1, 2, 3,...}.

5. Náhodná veličina Poznámka: Pro popis náhodného pokusu jsme zavedli pojem jevového pole S jako množiny všech možných výsledků a pravděpodobnost náhodných jevů P jako míru výskytů jednotlivých výsledků.

5. Náhodná veličina Poznámka: Pro popis náhodného pokusu jsme zavedli pojem jevového pole S jako množiny všech možných výsledků a pravděpodobnost náhodných jevů P jako míru výskytů jednotlivých výsledků.

Jaroslav Tuma. 8. února 2010

Semestrální práce z předmětu KMA/MM Odstraňování šumu z obrazu Jaroslav Tuma 8. února 2010 1 1 Zpracování obrazu Zpracování obrazu je disciplína zabývající se zpracováním obrazových dat různého původu.

Semestrální práce z předmětu KMA/MM Odstraňování šumu z obrazu Jaroslav Tuma 8. února 2010 1 1 Zpracování obrazu Zpracování obrazu je disciplína zabývající se zpracováním obrazových dat různého původu.

Množiny, relace, zobrazení

Množiny, relace, zobrazení Množiny Množinou rozumíme každý soubor určitých objektů shrnutých v jeden celek. Zmíněné objekty pak nazýváme prvky dané množiny. Pojem množina je tedy synonymem pojmů typu soubor,

Množiny, relace, zobrazení Množiny Množinou rozumíme každý soubor určitých objektů shrnutých v jeden celek. Zmíněné objekty pak nazýváme prvky dané množiny. Pojem množina je tedy synonymem pojmů typu soubor,

Teorie informace 21.9.2014. Obsah. Kybernetika. Radim Farana Podklady pro výuku

Teorie Radim Farana Podklady pro výuku Obsah Seznámení s problematikou a obsahem studovaného předmětu. Základní pojmy z Teorie, jednotka, informační obsah zprávy, střední délka zprávy, redundance. Kód.

Teorie Radim Farana Podklady pro výuku Obsah Seznámení s problematikou a obsahem studovaného předmětu. Základní pojmy z Teorie, jednotka, informační obsah zprávy, střední délka zprávy, redundance. Kód.

Zpracování náhodného vektoru. Ing. Michal Dorda, Ph.D.

Ing. Michal Dorda, Ph.D. 1 Př. 1: Cestující na vybraném spoji linky MHD byli dotazováni za účelem zjištění spokojenosti s kvalitou MHD. Legenda 1 Velmi spokojen Spokojen 3 Nespokojen 4 Velmi nespokojen

Ing. Michal Dorda, Ph.D. 1 Př. 1: Cestující na vybraném spoji linky MHD byli dotazováni za účelem zjištění spokojenosti s kvalitou MHD. Legenda 1 Velmi spokojen Spokojen 3 Nespokojen 4 Velmi nespokojen

Odpřednesenou látku naleznete v kapitole 3.3 skript Diskrétní matematika.

Lineární kódy, část 2 Odpřednesenou látku naleznete v kapitole 3.3 skript Diskrétní matematika. Jiří Velebil: A7B01LAG 22.12.2014: Lineární kódy, část 2 1/12 Dnešní přednáška 1 Analýza Hammingova (7, 4)-kódu.

Lineární kódy, část 2 Odpřednesenou látku naleznete v kapitole 3.3 skript Diskrétní matematika. Jiří Velebil: A7B01LAG 22.12.2014: Lineární kódy, část 2 1/12 Dnešní přednáška 1 Analýza Hammingova (7, 4)-kódu.

Komprese dat. Jan Outrata KATEDRA INFORMATIKY UNIVERZITA PALACKÉHO V OLOMOUCI. přednášky

Komprese dat Jan Outrata KATEDRA INFORMATIKY UNIVERZITA PALACKÉHO V OLOMOUCI přednášky Statistické metody Jan Outrata (Univerzita Palackého v Olomouci) Komprese dat Olomouc, únor březen 2016 1 / 23 Tunstallův

Komprese dat Jan Outrata KATEDRA INFORMATIKY UNIVERZITA PALACKÉHO V OLOMOUCI přednášky Statistické metody Jan Outrata (Univerzita Palackého v Olomouci) Komprese dat Olomouc, únor březen 2016 1 / 23 Tunstallův

Zdroje chyb. Absolutní a relativní chyba. Absolutní chyba. Absolutní chyba přibližného čísla a se nazývá absolutní hodnota rozdílu přesného

Zdroje chyb. Absolutní a relativní chyba. Absolutní chyba Absolutní chyba přibližného čísla a se nazývá absolutní hodnota rozdílu přesného čísla A a přibližného čísla a = A a. Je třeba rozlišovat dva případy:

Zdroje chyb. Absolutní a relativní chyba. Absolutní chyba Absolutní chyba přibližného čísla a se nazývá absolutní hodnota rozdílu přesného čísla A a přibližného čísla a = A a. Je třeba rozlišovat dva případy:

Náhodné jevy. Teorie pravděpodobnosti. Náhodné jevy. Operace s náhodnými jevy

Teorie pravděpodobnosti Náhodný pokus skončí jedním z řady možných výsledků předem nevíme, jak skončí (náhoda) příklad: hod kostkou, zítřejší počasí,... Pravděpodobnost zkoumá náhodné jevy (mohou, ale

Teorie pravděpodobnosti Náhodný pokus skončí jedním z řady možných výsledků předem nevíme, jak skončí (náhoda) příklad: hod kostkou, zítřejší počasí,... Pravděpodobnost zkoumá náhodné jevy (mohou, ale

pravděpodobnosti a Bayesova věta

NMUMP0 (Pravděpodobnost a matematická statistika I) Nezávislost, podmíněná pravděpodobnost, věta o úplné pravděpodobnosti a Bayesova věta. Házíme dvěma pravidelnými kostkami. (a) Jaká je pravděpodobnost,

NMUMP0 (Pravděpodobnost a matematická statistika I) Nezávislost, podmíněná pravděpodobnost, věta o úplné pravděpodobnosti a Bayesova věta. Házíme dvěma pravidelnými kostkami. (a) Jaká je pravděpodobnost,

Výběrové charakteristiky a jejich rozdělení

Katedra ekonometrie, FVL, UO Brno kancelář 69a, tel. 973 442029 email:jiri.neubauer@unob.cz Statistické šetření úplné (vyčerpávající) neúplné (výběrové) U výběrového šetření se snažíme o to, aby výběrový

Katedra ekonometrie, FVL, UO Brno kancelář 69a, tel. 973 442029 email:jiri.neubauer@unob.cz Statistické šetření úplné (vyčerpávající) neúplné (výběrové) U výběrového šetření se snažíme o to, aby výběrový

Dobývání znalostí. Doc. RNDr. Iveta Mrázová, CSc. Katedra teoretické informatiky Matematicko-fyzikální fakulta Univerzity Karlovy v Praze

Dobývání znalostí Doc. RNDr. Iveta Mrázová, CSc. Katedra teoretické informatiky Matematicko-fyzikální fakulta Univerzity Karlovy v Praze Dobývání znalostí Pravděpodobnost a učení Doc. RNDr. Iveta Mrázová,

Dobývání znalostí Doc. RNDr. Iveta Mrázová, CSc. Katedra teoretické informatiky Matematicko-fyzikální fakulta Univerzity Karlovy v Praze Dobývání znalostí Pravděpodobnost a učení Doc. RNDr. Iveta Mrázová,

Informace v počítači. Výpočetní technika I. Ing. Pavel Haluza ústav informatiky PEF MENDELU v Brně haluza@mendelu.cz

.. Informace v počítači Ing. Pavel Haluza ústav informatiky PEF MENDELU v Brně haluza@mendelu.cz Osnova přednášky Úvod do teorie informace základní pojmy měření množství informace ve zprávě přenos a kódování

.. Informace v počítači Ing. Pavel Haluza ústav informatiky PEF MENDELU v Brně haluza@mendelu.cz Osnova přednášky Úvod do teorie informace základní pojmy měření množství informace ve zprávě přenos a kódování

i=1 Přímka a úsečka. Body, které leží na přímce procházející body a a b můžeme zapsat pomocí parametrické rovnice

I. Funkce dvou a více reálných proměnných 1. Úvod Značení: V textu budeme používat označení: N pro množinu všech přirozených čísel; R pro množinu všech reálných čísel; R n pro množinu všech uspořádaných

I. Funkce dvou a více reálných proměnných 1. Úvod Značení: V textu budeme používat označení: N pro množinu všech přirozených čísel; R pro množinu všech reálných čísel; R n pro množinu všech uspořádaných

5 Orientované grafy, Toky v sítích

Petr Hliněný, FI MU Brno, 205 / 9 FI: IB000: Toky v sítích 5 Orientované grafy, Toky v sítích Nyní se budeme zabývat typem sít ových úloh, ve kterých není podstatná délka hran a spojení, nýbž jejich propustnost

Petr Hliněný, FI MU Brno, 205 / 9 FI: IB000: Toky v sítích 5 Orientované grafy, Toky v sítích Nyní se budeme zabývat typem sít ových úloh, ve kterých není podstatná délka hran a spojení, nýbž jejich propustnost

5.1. Klasická pravděpodobnst

5. Pravděpodobnost Uvažujme množinu Ω všech možných výsledků náhodného pokusu, například hodu mincí, hodu kostkou, výběru karty z balíčku a podobně. Tato množina se nazývá základní prostor a její prvky

5. Pravděpodobnost Uvažujme množinu Ω všech možných výsledků náhodného pokusu, například hodu mincí, hodu kostkou, výběru karty z balíčku a podobně. Tato množina se nazývá základní prostor a její prvky

Náhodný jev a definice pravděpodobnosti

Náhodný jev a definice pravděpodobnosti Obsah kapitoly Náhodný jev. Vztahy mezi náhodnými jevy. Pravidla pro počítání s pravděpodobnostmi. Formule úplné pravděpodobnosti a Bayesův vzorec. Studijní cíle

Náhodný jev a definice pravděpodobnosti Obsah kapitoly Náhodný jev. Vztahy mezi náhodnými jevy. Pravidla pro počítání s pravděpodobnostmi. Formule úplné pravděpodobnosti a Bayesův vzorec. Studijní cíle

Zadání a řešení testu z matematiky a zpráva o výsledcích přijímacího řízení do magisterského navazujícího studia od podzimu 2014

Zadání a řešení testu z matematiky a zpráva o výsledcích přijímacího řízení do magisterského navazujícího studia od podzimu 204 Zpráva o výsledcích přijímacího řízení do magisterského navazujícího studia

Zadání a řešení testu z matematiky a zpráva o výsledcích přijímacího řízení do magisterského navazujícího studia od podzimu 204 Zpráva o výsledcích přijímacího řízení do magisterského navazujícího studia

1 Analytické metody durace a konvexita aktiva (dluhopisu) $)*

Modely analýzy a syntézy plánů MAF/KIV) Přednáška 10 itlivostní analýza 1 Analytické metody durace a konvexita aktiva dluhopisu) Budeme uvažovat následující tvar cenové rovnice =, 1) kde jsou současná

Modely analýzy a syntézy plánů MAF/KIV) Přednáška 10 itlivostní analýza 1 Analytické metody durace a konvexita aktiva dluhopisu) Budeme uvažovat následující tvar cenové rovnice =, 1) kde jsou současná

1. Náhodný vektor (X, Y ) má diskrétní rozdělení s pravděpodobnostní funkcí p, kde. p(x, y) = a(x + y + 1), x, y {0, 1, 2}.

VIII. Náhodný vektor. Náhodný vektor (X, Y má diskrétní rozdělení s pravděpodobnostní funkcí p, kde p(x, y a(x + y +, x, y {,, }. a Určete číslo a a napište tabulku pravděpodobnostní funkce p. Řešení:

VIII. Náhodný vektor. Náhodný vektor (X, Y má diskrétní rozdělení s pravděpodobnostní funkcí p, kde p(x, y a(x + y +, x, y {,, }. a Určete číslo a a napište tabulku pravděpodobnostní funkce p. Řešení:

Apriorní rozdělení. Jan Kracík.

Apriorní rozdělení Jan Kracík jan.kracik@vsb.cz Apriorní rozdělení Apriorní rozdělení (spolu s modelem) reprezentuje informaci o neznámém parametru θ, která je dostupná předem, tj. bez informace z dat.

Apriorní rozdělení Jan Kracík jan.kracik@vsb.cz Apriorní rozdělení Apriorní rozdělení (spolu s modelem) reprezentuje informaci o neznámém parametru θ, která je dostupná předem, tj. bez informace z dat.

Odhady Parametrů Lineární Regrese

Odhady Parametrů Lineární Regrese Mgr. Rudolf B. Blažek, Ph.D. prof. RNDr. Roman Kotecký, DrSc. Katedra počítačových systémů Katedra teoretické informatiky Fakulta informačních technologií České vysoké

Odhady Parametrů Lineární Regrese Mgr. Rudolf B. Blažek, Ph.D. prof. RNDr. Roman Kotecký, DrSc. Katedra počítačových systémů Katedra teoretické informatiky Fakulta informačních technologií České vysoké

1. Obyčejné diferenciální rovnice

& 8..8 8: Josef Hekrdla obyčejné diferenciální rovnice-separace proměnných. Obyčejné diferenciální rovnice Rovnice, ve které je neznámá funkcí a v rovnici se vyskytuje spolu se svými derivacemi, se nazývá

& 8..8 8: Josef Hekrdla obyčejné diferenciální rovnice-separace proměnných. Obyčejné diferenciální rovnice Rovnice, ve které je neznámá funkcí a v rovnici se vyskytuje spolu se svými derivacemi, se nazývá

Experimentální realizace Buquoyovy úlohy

Experimentální realizace Buquoyovy úlohy ČENĚK KODEJŠKA, JAN ŘÍHA Přírodovědecká fakulta Univerzity Palackého, Olomouc Abstrakt Tato práce se zabývá experimentální realizací Buquoyovy úlohy. Jedná se o

Experimentální realizace Buquoyovy úlohy ČENĚK KODEJŠKA, JAN ŘÍHA Přírodovědecká fakulta Univerzity Palackého, Olomouc Abstrakt Tato práce se zabývá experimentální realizací Buquoyovy úlohy. Jedná se o

U Úvod do modelování a simulace systémů

U Úvod do modelování a simulace systémů Vyšetřování rozsáhlých soustav mnohdy nelze provádět analytickým výpočtem.často je nutné zkoumat chování zařízení v mezních situacích, do kterých se skutečné zařízení

U Úvod do modelování a simulace systémů Vyšetřování rozsáhlých soustav mnohdy nelze provádět analytickým výpočtem.často je nutné zkoumat chování zařízení v mezních situacích, do kterých se skutečné zařízení

Agent pracující v částečně pozorovatelném prostředí udržuje na základě senzorického modelu odhaduje, jak se svět může vyvíjet.

Umělá inteligence II Roman Barták, KTIML roman.bartak@mff.cuni.cz http://ktiml.mff.cuni.cz/~bartak Dnešní program Agent pracující v částečně pozorovatelném prostředí udržuje na základě senzorického modelu

Umělá inteligence II Roman Barták, KTIML roman.bartak@mff.cuni.cz http://ktiml.mff.cuni.cz/~bartak Dnešní program Agent pracující v částečně pozorovatelném prostředí udržuje na základě senzorického modelu

9.2. Zkrácená lineární rovnice s konstantními koeficienty

9.2. Zkrácená lineární rovnice s konstantními koeficienty Cíle Řešíme-li konkrétní aplikace, které jsou popsány diferenciálními rovnicemi, velmi často zjistíme, že fyzikální nebo další parametry (hmotnost,

9.2. Zkrácená lineární rovnice s konstantními koeficienty Cíle Řešíme-li konkrétní aplikace, které jsou popsány diferenciálními rovnicemi, velmi často zjistíme, že fyzikální nebo další parametry (hmotnost,

Diskrétní náhodná veličina. November 12, 2008

Diskrétní náhodná veličina November 12, 2008 (Náhodná veličina (náhodná proměnná)) Náhodná veličina (nebo též náhodná proměnná) je veličina X, jejíž hodnota je jednoznačně určena výsledkem náhodného pokusu.

Diskrétní náhodná veličina November 12, 2008 (Náhodná veličina (náhodná proměnná)) Náhodná veličina (nebo též náhodná proměnná) je veličina X, jejíž hodnota je jednoznačně určena výsledkem náhodného pokusu.

Kombinatorická minimalizace

Kombinatorická minimalizace Cílem je nalézt globální minimum ve velké diskrétní množině, kde může být mnoho lokálních minim. Úloha obchodního cestujícího Cílem je najít nejkratší cestu, která spojuje všechny

Kombinatorická minimalizace Cílem je nalézt globální minimum ve velké diskrétní množině, kde může být mnoho lokálních minim. Úloha obchodního cestujícího Cílem je najít nejkratší cestu, která spojuje všechny

prof. RNDr. Roman Kotecký DrSc., Dr. Rudolf Blažek, PhD Pravděpodobnost a statistika Katedra teoretické informatiky Fakulta informačních technologií

prof. RNDr. Roman Kotecký DrSc., Dr. Rudolf Blažek, PhD Katedra teoretické informatiky Fakulta informačních technologií České vysoké učení technické v Praze c Rudolf Blažek, Roman Kotecký, 2011 Pravděpodobnost

prof. RNDr. Roman Kotecký DrSc., Dr. Rudolf Blažek, PhD Katedra teoretické informatiky Fakulta informačních technologií České vysoké učení technické v Praze c Rudolf Blažek, Roman Kotecký, 2011 Pravděpodobnost

10. N á h o d n ý v e k t o r

10. N á h o d n ý v e k t o r 10.1. Definice: Náhodný vektor. Uspořádanou n tici (X 1, X 2,..., X n ) náhodných veličin X i, 1 i n, nazýváme náhodným vektorem. Poznámka: Pro jednoduchost budeme zavádět

10. N á h o d n ý v e k t o r 10.1. Definice: Náhodný vektor. Uspořádanou n tici (X 1, X 2,..., X n ) náhodných veličin X i, 1 i n, nazýváme náhodným vektorem. Poznámka: Pro jednoduchost budeme zavádět

Dnešní látka Opakování: normy vektorů a matic, podmíněnost matic Jacobiova iterační metoda Gaussova-Seidelova iterační metoda

Předmět: MA 4 Dnešní látka Opakování: normy vektorů a matic, podmíněnost matic Jacobiova iterační metoda Gaussova-Seidelova iterační metoda Četba: Text o lineární algebře v Příručce přežití na webových

Předmět: MA 4 Dnešní látka Opakování: normy vektorů a matic, podmíněnost matic Jacobiova iterační metoda Gaussova-Seidelova iterační metoda Četba: Text o lineární algebře v Příručce přežití na webových

1 Linearní prostory nad komplexními čísly

1 Linearní prostory nad komplexními čísly V této přednášce budeme hledat kořeny polynomů, které se dále budou moci vyskytovat jako složky vektorů nebo matic Vzhledem k tomu, že kořeny polynomu (i reálného)

1 Linearní prostory nad komplexními čísly V této přednášce budeme hledat kořeny polynomů, které se dále budou moci vyskytovat jako složky vektorů nebo matic Vzhledem k tomu, že kořeny polynomu (i reálného)

10. Soustavy lineárních rovnic, determinanty, Cramerovo pravidlo

0. Soustavy lineárních rovnic, determinanty, Cramerovo pravidlo (PEF PaA) Petr Gurka aktualizováno 9. prosince 202 Obsah Základní pojmy. Motivace.................................2 Aritmetický vektorový

0. Soustavy lineárních rovnic, determinanty, Cramerovo pravidlo (PEF PaA) Petr Gurka aktualizováno 9. prosince 202 Obsah Základní pojmy. Motivace.................................2 Aritmetický vektorový

Diskrétní matematika. DiM /01, zimní semestr 2017/2018

Diskrétní matematika Petr Kovář petr.kovar@vsb.cz Vysoká škola báňská Technická univerzita Ostrava DiM 470-2301/01, zimní semestr 2017/2018 O tomto souboru Tento soubor je zamýšlen především jako pomůcka

Diskrétní matematika Petr Kovář petr.kovar@vsb.cz Vysoká škola báňská Technická univerzita Ostrava DiM 470-2301/01, zimní semestr 2017/2018 O tomto souboru Tento soubor je zamýšlen především jako pomůcka

SHANNONOVA TEORIE TAJNÉ KOMUNIKACE

SHANNONOVA TEORIE TAJNÉ KOMUNIKACE Verze 1.3 ANDREW KOZLÍK 1. ÚVOD DO DISKRÉTNÍ PRAVDĚPODOBNOSTI Uvažujme náhodný pokus, při kterém házíme dokonale symetrickou kostkou a zaznamenáváme číslo, které padlo.

SHANNONOVA TEORIE TAJNÉ KOMUNIKACE Verze 1.3 ANDREW KOZLÍK 1. ÚVOD DO DISKRÉTNÍ PRAVDĚPODOBNOSTI Uvažujme náhodný pokus, při kterém házíme dokonale symetrickou kostkou a zaznamenáváme číslo, které padlo.

PRIMITIVNÍ FUNKCE. Primitivní funkce primitivní funkce. geometrický popis integrály 1 integrály 2 spojité funkce konstrukce prim.

PRIMITIVNÍ FUNKCE V předchozích částech byly zkoumány derivace funkcí a hlavním tématem byly funkce, které derivace mají. V této kapitole se budou zkoumat funkce, které naopak jsou derivacemi jiných funkcí

PRIMITIVNÍ FUNKCE V předchozích částech byly zkoumány derivace funkcí a hlavním tématem byly funkce, které derivace mají. V této kapitole se budou zkoumat funkce, které naopak jsou derivacemi jiných funkcí

Značení 1.1 (posloupnost výsledků pokusu). Mějme posloupnost opakovaných (i závislých) pokusů,

Rekurentní jevy Značení. (posloupnost výsledků pokusu). Mějme posloupnost opakovaných (i závislých) pokusů, kde každý má tutéž konečnou nebo spočetnou množinu výsledků E, E,...}. Pak E j,..., E jn } značí

Rekurentní jevy Značení. (posloupnost výsledků pokusu). Mějme posloupnost opakovaných (i závislých) pokusů, kde každý má tutéž konečnou nebo spočetnou množinu výsledků E, E,...}. Pak E j,..., E jn } značí

Osnova přednášky. Informace v počítači. Interpretace dat. Údaje, data. Úvod do teorie informace. Výpočetní technika I. Ochrana dat

Osnova přednášky 2/44 Informace v počítači Ing Pavel Haluza ústav informatiky PEF MENDELU v Brně haluza@mendelucz základní pojmy měření množství informace ve zprávě přenos a kódování dat parita kontrolní

Osnova přednášky 2/44 Informace v počítači Ing Pavel Haluza ústav informatiky PEF MENDELU v Brně haluza@mendelucz základní pojmy měření množství informace ve zprávě přenos a kódování dat parita kontrolní

DOE (Design of Experiments)

DOE - DOE () DOE je experimentální strategie, při které najednou studujeme účinky několika faktorů, prostřednictvím jejich testování na různých úrovních. Charakteristika jakosti,y je veličina, pomocí které

DOE - DOE () DOE je experimentální strategie, při které najednou studujeme účinky několika faktorů, prostřednictvím jejich testování na různých úrovních. Charakteristika jakosti,y je veličina, pomocí které

Zavedení a vlastnosti reálných čísel

Zavedení a vlastnosti reálných čísel jsou základním kamenem matematické analýzy. Konstrukce reálných čísel sice není náplní matematické analýzy, ale množina reálných čísel R je pro matematickou analýzu

Zavedení a vlastnosti reálných čísel jsou základním kamenem matematické analýzy. Konstrukce reálných čísel sice není náplní matematické analýzy, ale množina reálných čísel R je pro matematickou analýzu

V kompletním grafu nenastává problém. Každý uzel je soused se zbytkem vrcholů a může s nimi kdykoliv komunikovat.

1 SMĚROVÁNÍ (ROUTING) V kompletním grafu nenastává problém. Každý uzel je soused se zbytkem vrcholů a může s nimi kdykoliv komunikovat. Problém nastává u ostatních grafů: Kritéria dobrého směrování: a)

1 SMĚROVÁNÍ (ROUTING) V kompletním grafu nenastává problém. Každý uzel je soused se zbytkem vrcholů a může s nimi kdykoliv komunikovat. Problém nastává u ostatních grafů: Kritéria dobrého směrování: a)

Elegantní algoritmus pro konstrukci sufixových polí

Elegantní algoritmus pro konstrukci sufixových polí 22.10.2014 Zadání Obsah Zadání... 3 Definice... 3 Analýza problému... 4 Jednotlivé algoritmy... 4 Algoritmus SA1... 4 Algoritmus SA2... 5 Algoritmus

Elegantní algoritmus pro konstrukci sufixových polí 22.10.2014 Zadání Obsah Zadání... 3 Definice... 3 Analýza problému... 4 Jednotlivé algoritmy... 4 Algoritmus SA1... 4 Algoritmus SA2... 5 Algoritmus

3 Bodové odhady a jejich vlastnosti

3 Bodové odhady a jejich vlastnosti 3.1 Statistika (Skripta str. 77) Výběr pořizujeme proto, abychom se (více) dověděli o souboru, ze kterého jsme výběr pořídili. Zde se soustředíme na situaci, kdy známe

3 Bodové odhady a jejich vlastnosti 3.1 Statistika (Skripta str. 77) Výběr pořizujeme proto, abychom se (více) dověděli o souboru, ze kterého jsme výběr pořídili. Zde se soustředíme na situaci, kdy známe

Pravděpodobnost a statistika (BI-PST) Cvičení č. 4

Pravděpodobnost a statistika (BI-PST) Cvičení č. 4 J. Hrabáková, I. Petr, F. Štampach, D. Vašata Katedra aplikované matematiky Fakulta informačních technologií České vysoké učení technické v Praze ZS 2014/2015

Pravděpodobnost a statistika (BI-PST) Cvičení č. 4 J. Hrabáková, I. Petr, F. Štampach, D. Vašata Katedra aplikované matematiky Fakulta informačních technologií České vysoké učení technické v Praze ZS 2014/2015

Grafy. doc. Mgr. Jiří Dvorský, Ph.D. Katedra informatiky Fakulta elektrotechniky a informatiky VŠB TU Ostrava. Prezentace ke dni 13.

Grafy doc. Mgr. Jiří Dvorský, Ph.D. Katedra informatiky Fakulta elektrotechniky a informatiky VŠB TU Ostrava Prezentace ke dni 13. března 2017 Jiří Dvorský (VŠB TUO) Grafy 104 / 309 Osnova přednášky Grafy

Grafy doc. Mgr. Jiří Dvorský, Ph.D. Katedra informatiky Fakulta elektrotechniky a informatiky VŠB TU Ostrava Prezentace ke dni 13. března 2017 Jiří Dvorský (VŠB TUO) Grafy 104 / 309 Osnova přednášky Grafy

Fyzikální korespondenční seminář MFF UK

Úloha I.E... Pechschnitte 12 bodů; (chybí statistiky) Padá krajíc namazanou stranou dolů? Zkoumejte experimentálně tento Murphyho zákon s důrazem na statistiku! Záleží na rozměrech krajíce, složení a typu

Úloha I.E... Pechschnitte 12 bodů; (chybí statistiky) Padá krajíc namazanou stranou dolů? Zkoumejte experimentálně tento Murphyho zákon s důrazem na statistiku! Záleží na rozměrech krajíce, složení a typu